Rykte, tradition och antal studenter hade tidigare till stor del legat till grund för statens tilldelning av ekonomiska resurser till Sveriges universitet och högskolor.

Men vid regeringsskiftet för ett drygt decennium sedan hände något. Alliansregeringen ville se resultat, och införde ett kvalitetsbaserat resursfördelningssystem för forskningsanslagen. Det innebar bland annat att man tog 10–20 procent från lärosätenas forskningsanslag, lade dem i en pott för att sedan fördela dessa medel utifrån två indikatorer: dels bibliometri (citerade publiceringar av forskare knutna till lärosätena), dels externa pengar (från exempelvis Vetenskapsrådet och andra statliga eller privata forskningsfinansiärer).

I denna förändringsprocess spelade Ulf Sandström, docent och forskare vid KTH, en avgörande roll.

Det var han och sonen Erik Sandström som i en statlig utredning (»Resurser för kvalitet«, 2007:81) tog fram ett system för omfördelning, ett bibliometriskt index – en form för att mäta citeringar som kvalitetsfaktor – som sedan skulle ligga till grund för villkoren för omfördelningen och tilldelningen av universitetens och högskolornas pengar. Året därpå fattade regeringen beslut om att från och med 2009 låta bibliometri (statistisk analys av publikationer) vara en aspekt för hur mycket pengar som omfördelades.

De senaste åren har någon omfördelning av befintliga forskningsanslag dock inte skett. Något som Ulf Sandström ser som ett problem.

–Att publicera artiklar är vad forskning handlar om. Och eftersom det till stor del är skattepengar som bekostar våra universitet och högskolor är det viktigt att man får ut bra resultat utan att det kostar för mycket, säger han.

LÄS OCKSÅ: Topp 28: Här är Sveriges bästa universitet

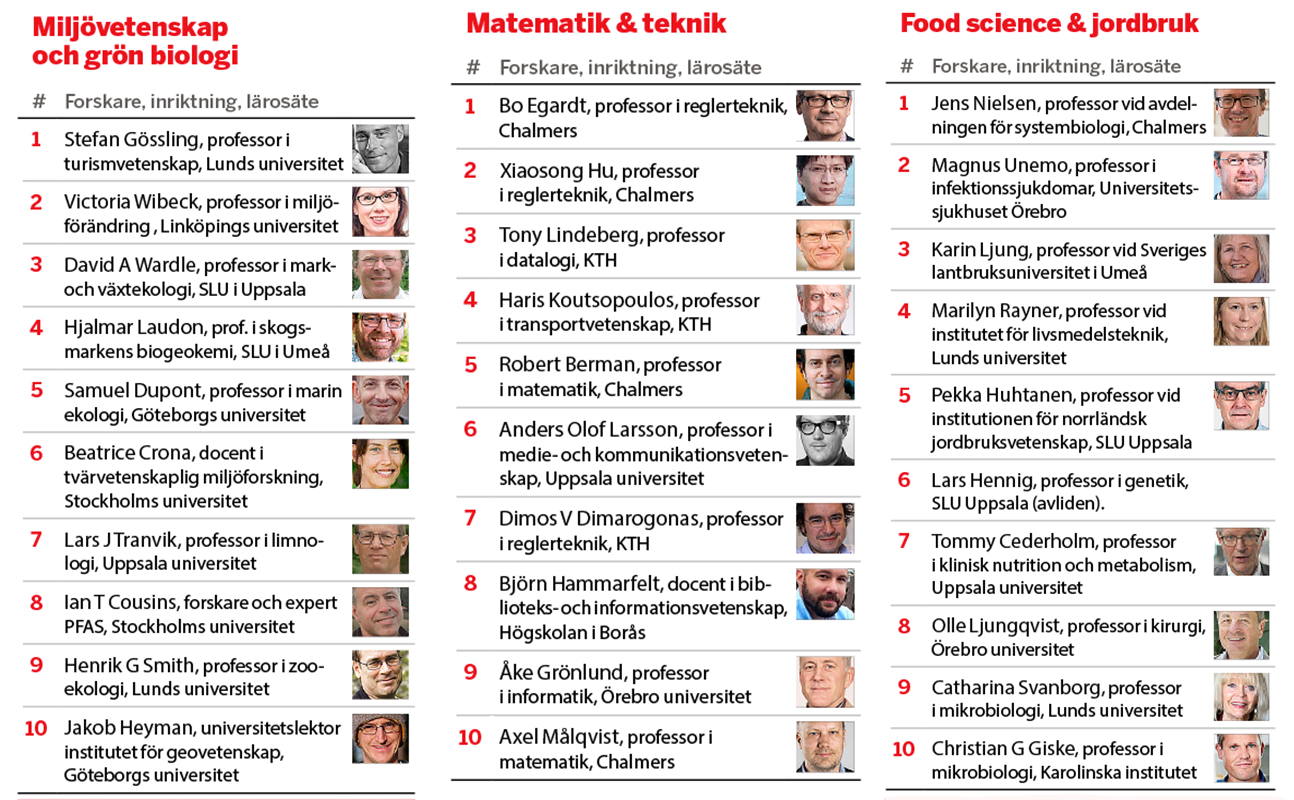

Rankning av enskilda forskare utifrån mest produktiva och citerade namn:

Ulf Sandström ligger också bakom den rankning av landets universitet och högskolor som Fokus presenterar. En rankning som i första hand värderar universitet och högskolor utifrån prestation och konkreta resultat, i form av artikelproduktion och citeringar av forskare knutna till svenska lärosäten.

Ulf Sandström rör sig snabbt och hemtamt över innergården mellan Kungliga Tekniska högskolans mörkröda tegelbyggnader i Stockholm, stannar till och hälsar på en av sina doktorander. Över en lunch på högskolans restaurang berättar han om den metod som han har använt sig av.

Dels har han utgått från hur mycket universiteten har »producerat« under en viss period; alltså i hur hög grad lärosätenas forskares artiklar har citerats i internationella tidskrifter. Dels har han relaterat produktionen till de ekonomiska resurser som universiteten får (pengar från staten eller via extern finansiering, som forskningsråd och stiftelser).

Och medan anrika lärosäten som Karolinska institutet, Uppsala och Lunds universitet i traditionella, internationella rankningar brukar hamna bland de 100 bästa, blir det i denna rangordning Malmö universitet som kniper förstaplatsen. Även oväntade uppstickare som Örebro universitet och Högskolan i Jönköping hamnar här bland de tio bästa.

Med hjälp av samma metod för produktion och citeringar har Ulf Sandström dessutom tagit fram vilka forskare som ligger i topp per »disciplin«. En kärntrupp av forskare som kontinuerligt producerar artiklar står för lejonparten av högciterade publikationer. Ju oftare en forskare har citerats och ju mer frekvent över tid, desto högre poäng får lärosätet där forskaren är verksam.

I sina rankningar utgår Ulf Sandström från en sammanräkning av alla publikationer och citeringar från närmare 20 000 internationella, vetenskapliga tidskrifter mellan 2012 och 2015, men med citeringar räknade fram till och med år 2017. Dessa finns samlade i den internationella databasen Web of science. Artiklarna genererar poäng utifrån hur »starka« artiklarna är, det vill säga hur de används av forskare i internationella tidskrifter. Och det är inte bara tillfällig popularitet som räknas; artiklar som citeras många gånger över perioden ger fler poäng.

Sveriges 800 mest produktiva forskare – här hittar du hela listan!

I den rangordning som avser enskilda forskares prestationer hamnar, som väntat, forskare knutna till universiteten i Stockholm och Lund högt. Men här utmärker sig även forskare vid exempelvis Linköpings universitet, som blev universitet först på 1960-talet och inte har kunnat etablera sig med fasta forskningsresurser på samma sätt som äldre universitet.

– Medan kända namn som Lunds universitet och KTH ser ut att glida på gamla meriter känner sig Linköping som en lillebror, vilket kan vara bra – då lägger man på ett extra kol, säger Ulf Sandström.

I flera länder har universitet som fått mer statliga resurser visat bättre resultat, medan de som i högre grad litar till extern finansiering får sämre. Även i denna rankning visar statligt välfinansierade universitet som Stockholm och Lund de bästa prestationerna. Men även Linköpings universitet, som till stor del är beroende av externa medel, överraskar alltså med gott resultat.

– Att universitet i Linköping, Malmö och Karolinska institutet ändå hamnar högt i rankningen är en indikation på att det går att skapa bra resultat med externa pengar, resonerar Ulf Sandström.

Han gör ingen hemlighet av att det i denna rankning är produktion och uppmärksamhet som han definierar som främsta måttet för kvalitet.

– För att kunna vara en duktig forskare är det nödvändigt att vara produktiv och få ut många artiklar i olika tidskrifter. De universitet och högskolor som får in mycket pengar borde kunna producera mer, och har därmed större möjlighet att få högciterade artiklar.

Men flitigt citerad artikelproduktion som mått på kvalitet omfamnas långtifrån av alla.

Enligt Jonna Bornemark, filosof vid Centrum för praktisk kunskap vid Södertörns högskola och författare till boken »Det omätbaras renässans« (2019), går kvalitet när det gäller universitet och forskning inte att mäta utifrån citeringar. Dessutom styr det måttet forskarnas arbete och inriktning, menar hon.

– För att bli citerad gäller det att skriva något som många har direkt användning för. Risken är också att forskare inom humaniora och samhällsvetenskap, för att citeras så brett som möjligt, bara siktar på att citeras i anglosaxiska tidskrifter. Något som resulterar i ett visst sätt att skriva, som bara vänder sig till vissa grupper.

LÄS OCKSÅ: Professorn: »Fara om jakten på citat blir enda drivkraften«

Fokus på citeringar riskerar enligt Jonna Bornemark också att få en stagnerande inverkan på forskningen och bli en bromskloss för nya, stora tankar som går mot strömmen.

– Vissa områden som fungerar just nu premieras på bekostnad av andra, mer nyskapande.

Universiteten använder ju offentliga medel – bör man inte kräva resultat för pengarna?

– Jo, men att lägga manken till behöver inte innebära att anpassa sig efter ett visst system och skriva på ett visst sätt. Om forskare exempelvis i stället för att skriva om Sverige väljer att undersöka amerikanska fenomen för att få fler citeringar, då kommer skattepengarna inte till rätt användning.

Ska man då ge upp tanken på att kunna mäta universitetens kvalitet?

– Nej, men jag förstår inte varför denna kvalitetsmätning måste ske genom rankning. Kvalitetsgranskningar görs redan av Universitetskanslersämbetet.

Att utgå från att forskare vid universitet är lata och skulle behöva hårdare piska är fel, anser Jonna Bornemark.

– Kvalitetsarbete borde snarare handla om att freda tiden för att forskarna ska kunna göra ett bra jobb.

Jonna Bornemark tar tydligt avstånd från att mäta lärosätenas kvalitet utifrån citerad artikelproduktion till lägsta möjliga kostnad:

– Forskning kan aldrig handla om kvantitet.

Sveriges 800 mest produktiva forskare – här hittar du hela listan!

Att metoden ger poäng utifrån vilka artiklar som fortsätter att citeras år efter år kan i och för sig säga något om kvaliteten, medger hon, men det garanterar den inte, och hindrar oss från att tänka på forskning som en levande kropp.

– Det finns en risk att hela forskningen anpassas efter mätsystemet.

Att på Sandströms sätt mäta produktion jämförs av Jonna Bornemark med New public management, ett sätt att mäta som från början användes inom industri och näringsliv och som de senaste årtiondena tillämpats även i offentliga verksamheter, till exempel i vård och universitets- och högskolevärlden. Inte heller forskningen står alltså fri från det Jonna Bornemark kallar ratiofiering; att den ska kvalitetssäkras med verktyg som »kvantifierar den och anpassar den till de kategorier som låter sig mätas«. Men humaniora, religion och konst låter sig inte reduceras till det mätbara, hävdar Jonna Bornemark, som anser att detta sätt att mäta även osynliggör »det akademiska livets livsnerv, det vill säga seminariet i dess olika former, där texter diskuteras och kritiska samtal förs«.

Och hon är inte ensam om att ifrågasätta citeringar som kvalitetsmätning i universitetsvärlden. Thorsten Nybom, professor i historia vid Uppsala universitet, har själv medverkat i universitetsrankningar, men med viss självkritik ställt sig frågan om dessa mäter det som går att mäta snarare än mäter det som räknas. Men samtidigt vänder han sig mot tendensen från de högre utbildningarnas företrädare att moralisera.

Kritiken av rankningarna är visserligen välgrundad. Men kritik har också riktats mot mer genomtänkta försök att mäta kvalitet, bara för att sluta i ett envist hävdande att just forskning och kvalificerad utbildning är så delikata, komplicerade områden att de bara kan utvärderas av utövarna själva.

– Även om nuvarande metoder för att kontrollera universitetens arbete brister, finns behov av mer insyn och extern kontroll av dessa lärosäten, säger Thorsten Nybom.

LÄS OCKSÅ: Topp 28: Här är Sveriges bästa universitet

Ulf Sandström tillbakavisar dock att mätning av publikationer måste ha något med New public management att göra.

»Publish or perish«-traditionen (»publicera eller försvinna«), det vill säga att utgå från hur mycket forskare citeras i tidskrifter, sträcker sig åtminstone tillbaka till 1930-talet, och bibliometrin (en statistisk analys av publikationer) föddes redan på 1800-talet.

Men medan man i början av 1990-talet från varje universitet fick skicka in till regeringen hur många publikationer som man haft under en viss period har utvecklade databaser nu lett till mer specifika krav på utvärdering och jämförande studier.

– Man ägnar sig åt forskning därför att man vill publicera. Har man ingen diskussion med sina kollegor runt om i världen så tynar verksamheten bort, säger Ulf Sandström, som inte håller med om att fokus på citeringar skulle hämma nytänkande. Tvärtom, menar han, kännetecknas artiklar som får stort genomslag i tidskrifter ofta av det »atypiska« och blir nydanande forskning.

Forskare producerar i regel en artikel om året. Så har det sett ut sedan efterkrigstiden. Antalet artiklar per forskare blir inte fler för att man har börjat mäta vad de gör. Det ökade intresset för att mäta har inte heller lett till att artiklarna blir kortare, snarare längre, menar Ulf Sandström.

– Inom bibliometri tror man, att när många söker sig till något, så är det rätt.

Finns det inte en risk för att forskningen då styrs av populistiska ämnen?

– Nej, forskning är styrt av sina villkor. Forskarna bildar olika forskningsfronter och man bryr sig bara om det som finns inom den fronten eller det som kan tillföra något. Att komma med något först är särskilt viktigt, säger Ulf Sandström, som däremot är skeptisk till traditionella, internationella högskolerankningar, till exempel Times higher education.

– Den ger för stort utrymme åt tveksamma metoder för att mäta hur känt ett lärosäte är och ger därmed utrymme för manipulation av systemet. Dessutom tar man inte hänsyn till hur mycket resurser som går åt, vilket är poängen med Fokus högskolerankning.

Rankningen tar dock inte hänsyn till indikatorer som lärarledd undervisningstid. Och i det avseendet ligger svenska högskolor på låg nivå jämfört med flera andra länder. En student på svensk högskola har i snitt omkring 10 timmar lärarledd tid per vecka, medan motsvarande genomsnitt i Polen, Portugal och Albanien ligger kring drygt 20 timmar, enligt en rapport från Universitetskanslersämbetet 2018.

LÄS OCKSÅ: Professorn: »Fara om jakten på citat blir enda drivkraften«

Den lärarledda tiden varierar också mellan olika utbildningsområden. Medan en civilingenjörsstudent i genomsnitt har 18 timmar per vecka, kan en sociologistudent i genomsnitt få 6 timmar i veckan. I vissa fall får humaniorastudenter endast 2 lärarledda undervisningstimmar i veckan, berättar Sandra Magnusson, vice kårordförande vid Göta studentkår, Göteborgs universitet.

– Ofta behöver man mer undervisningstid. Vissa samhällsvetenskapliga kurser, där resurser saknas för att anlita föreläsare, blir nästan självstudier, säger hon.

Visst kan lärarledd undervisning också vara viktigt för ett universitets kvalitet, medger Ulf Sandström.

– Men jag skiljer på forskning och undervisning. Ambitionen är inte att mäta hela universitetets kvalitet. Och även ur studentperspektiv är det attraktivt att intressant forskning pågår.

Regeringen har ökat forskningsanslagen med 1,3 miljarder kronor under 2018–2020. Av detta har knappt hälften fördelats utifrån bibliometri och externa medel, meddelar Matilda Ernkrants (S), minister för högre utbildning och forskning.

–Även om en omfördelning av lärosätenas anslag inte skett de senaste åren har en viss del av ökningen alltid fördelats utifrån bibliometri, uppger hon.

Rankning av enskilda forskare utifrån mest produktiva och citerade namn:

Sveriges 800 mest produktiva forskare – här hittar du hela listan!

FAKTA | Så gjordes rankningen

Högskolerankningen rangordnar universiteten utifrån den kostnad de har per »poäng«, alltså resurser som går åt per upparbetade citerings- och produktionspoäng från forskare som är knutna till lärosätet.

För att kompensera för olikheter i vetenskaplig produktionstakt mellan forskningsområden justeras poängen som varje artikel får genom metoden FAP (Field adjusted production). Humanistiska områden värderas exempelvis högre med denna metod. På basis av produktionsvärdet ges artiklarna sedan sin slutgiltiga poäng genom att använda citeringsnivån.

Professor Ulf Sandström har identifierat de 100 bästa forskarna i landet inom åtta olika områden baserat på produktions- och citeringspoäng. Forskarna, totalt närmare 60 000 i Sverige, är från alla forskningsfält: naturvetare, tekniker, medicinare, samhälls- och beteendevetare och humanister.

Andelen kvinnor i hela populationen av svenska forskare är 44 procent. Av topprestationerna, det vill säga de 600 mest produktiva, är drygt 29 procent kvinnor. Av de 80 forskare som presenteras i Fokus rankning är 13 procent kvinnor.

Varje artikel rangordnas baserat på citeringar inom respektive vetenskapsfält som anges i Web of science och delas in i grupper. Sedan översätts en indikator (kallad percentilindikator) till ett poängantal för varje artikel, där en artikel som hör till den mest citerade procenten av artiklarna exempelvis tilldelas 100 poäng. En artikel som hör till de 50 procent minst citerade ger 1 poäng, något som gör att en forskare inte kan förlora på att publicera en artikel.

I ett enda värde uttrycks därmed produktivitet (antal artiklar) och citeringsnivå (kvalitet).